こんにちは。アクセシビリティの第11代黒帯(ヤフー内のスキル任命制度)の中野 信です。

昨年に続いての登板ですが、今回は「動画のアクセシビリティ」について話をします。

昨年から今年にかけて、新型コロナウィルスの影響で自宅にいる時間が増えたかと思います。

GYAO!やNetflixといった動画サービスを見る時間も増えましたし、会社のミーティングもオンライン会議に変わりました。セミナーやイベントもオンライン開催が多くなったかと思います。また、動画を撮影・公開することもスマホで簡単にできるようになりましたし、動画編集や動画配信の情報と機材もここ2年ほどで充実してきました。一方で、動画で情報提供を行うときに、音が聞こえないとまったく情報が伝わらなかったり、映像が見えないことで何が起きているか分からないといったことも起きています。そもそも情報提供者がそのことに気づいていない場合もあります。

今回は、ユーザーに動画を届ける際にどんな支援方法があるかを、少しでも感じ取ってもらえればと思います。

代替情報の提供パターン(情報保障)

まずは代替情報の話です。 ウェブアクセシビリティで代替情報というと「画像の代替テキスト」を思い浮かべる方も多いと思いますが、写真や図をテキストに置き換えて提供される情報です。見えない際であっても、他の手段でその情報を伝えられるようにすることを「情報保障」といいます。

動画の代替情報は「字幕」「キャプション」「副音声」などがあります。

字幕とキャプションの違いは?

字幕とキャプションは主に音声が聞こえなかったり出せない場合に有用な情報保障の手段です。

「字幕」は、動画の中に登場する人が話した内容を文字にするものです。海外の映画の日本語字幕がイメージしやすいと思います。一方、「キャプション」は、字幕に加えて効果音、音楽などの情報も文字として表現するものです。キャプションの方が字幕より多くの情報を提供する手段といえます。

しかし、ウェブアプリケーションやデジタルツールではあまり厳密な使い分けをしていない場合が多いので、ここでは字幕もキャプションも「キャプション」として話をします。

オープンキャプションとクローズドキャプション

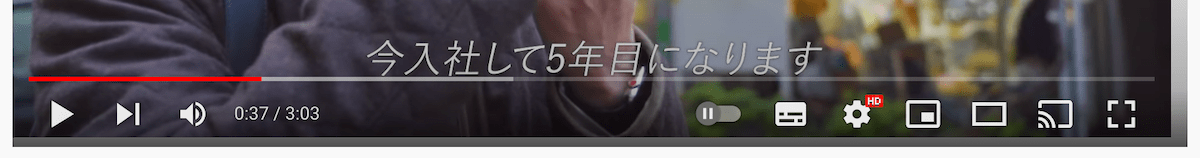

ウェブやスマホアプリでキャプションを表示する方法は大きく分けて「オープンキャプション」と「クローズドキャプション」の2通りあります。さて、次の画像のキャプションはどちらの方法でしょうか?

(Yahoo! JAPAN 採用ムービー 「変化と共に働く」篇 - YouTubeより)

(Yahoo! JAPAN 採用ムービー 「変化と共に働く」篇 - YouTubeより)

正解は「オープンキャプション」という方法で表示されたキャプションです。

これは、映像に文字画像としてキャプションを表示する方法です。「オープン」と「クローズド」は間違えやすいのですが、動画に画像として埋め込まれているのが「オープン」、プレーヤーの機能でキャプション用の別データを重ねているのが「クローズド」です。

動画制作者がキャプションのレイアウトやフォントを選んで作り込むことで、映像表現の一種として使えたり、いくつかの媒体やプラットフォームから動画を配信するときに個別に対応しなくてよいというメリットがありそうです。

なお、キャプションを作成するためには音声を手動で文字起こしして文字数とタイミングを合わせて動画に配置していく、という非常に手間のかかる作業が必要でしたが、Adobe Premiere Proには「音声テキスト変換」という、AIを使って音声から文字起こしをする機能が追加されたりと、技術の力で手間が減らせるようになってきています。

しかし、Premiere Proの音声テキスト変換を、家族を撮影した動画で試してみたところ、精度に関してはまだ何とも言えない状態でした。これは、音声解析の技術や精度より、そもそもの動画の音声が鮮明に録音できていなかったり環境音が入っているのが問題なようです。人が聞く分にはまったく気になっていなかったので、無意識に音を選り分けて認識する能力はすごいと感じました。

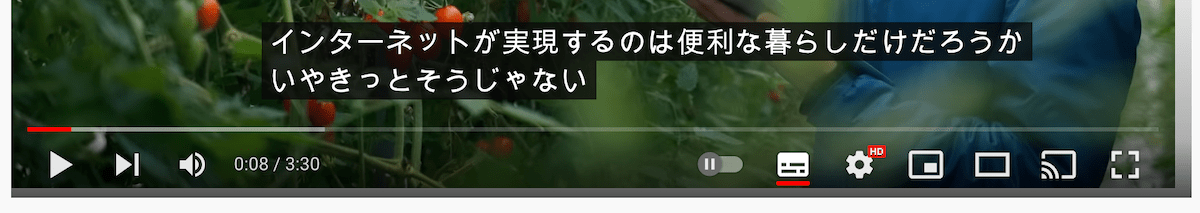

そして、もうひとつの方法の「クローズドキャプション」という方法です。以下はYouTubeのクローズドキャプション機能のスクリーンショットです。

(Yahoo! JAPAN ビジョン動画 「UPDATE JAPAN」2018 - YouTubeより)

(Yahoo! JAPAN ビジョン動画 「UPDATE JAPAN」2018 - YouTubeより)

クローズドキャプションであれば、キャプションの表示オンオフや文字サイズの変更をユーザーが行えます。さらに、サービスによってはキャプションを機械翻訳したりキーワード検索ができたりと、ユーザーに合わせたさまざまな使い方ができます。

YouTubeであれば、動画をアップロードすると自動的に音声解析を行ってクローズドキャプションを作成してくれます。間違っている場合も多いですがクリアな音声の場合は高精度で作成されるため、音声が聞こえない場合の代替情報にも使えますし、機械翻訳して他言語の動画を見ることもできます。

なお、クローズドキャプションについてはテレビの地上波放送がとても丁寧な対応をしています。総務省の2020年10月の報告によると、キー局5局ではすべての番組が字幕放送となっていますので、テレビのリモコンにある「字幕」を押すと字幕が表示されない番組はないといってよいです。キャプションを作る時に参考になると思います。

要約筆記

発話内容をその場で専門の方が文章にまとめる方法です。会議やセミナーなどの情報保障で使われています。

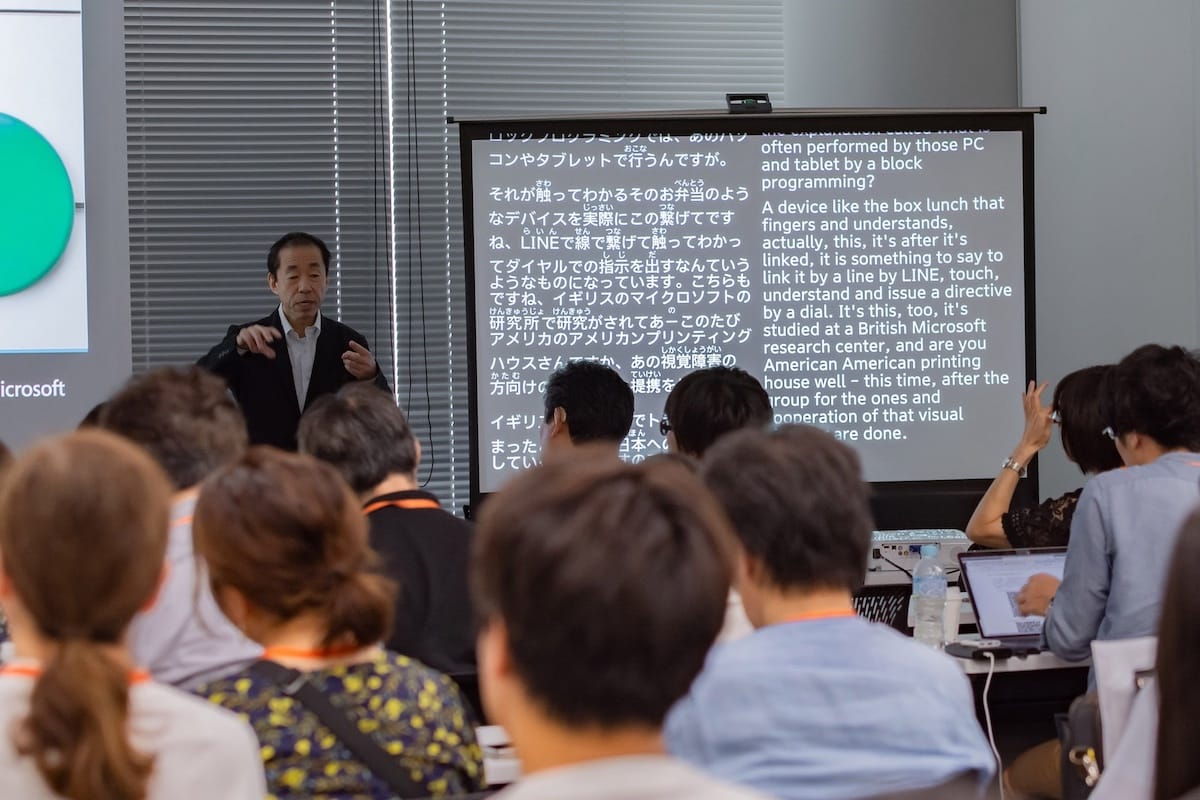

過去にはホワイトボードに手書きで会場に伝えるという方法でしたが、今はパソコンで入力した内容をプロジェクターなどに投影して伝えています。

キャプションは発話内容を忠実に伝えることを基本にしているため、冗長になったり話の整合性がとれない場合もありますが、要約筆記は端的な文章になるため、話が理解しやすいというメリットがあります。

なお、ヤフーでは全社朝礼などの大きな発表の時に、要約筆記に似た方法で発表者の発言を書き起こしてスライドと一緒にSlackのチャンネルに流すということをしています。もともとは配信サービスの負荷軽減やネットワーク負荷軽減が目的で行われていたことですが、意図せず代替情報にもなっていたともいえます。

手話

手としぐさで情報伝達をする方法です。政治家の記者会見で目にすることが多いと思います。

この写真は、Japan Accessibility Conference vol.2という、ヤフーを含む複数社の共催によるイベントの様子です。アクセシビリティのイベントなので情報保障に配慮して、手話とUDトークによる日英の字幕表示を行いました。

手話にはいくつか種類がありますが、日本語の文法と一致した「日本語対応手話」という手話と、独自の文法の「日本手話」という手話がよく使われます。

中途失聴者や聴者は日本語が第一言語で日本語対応手話を使うことが多いですが、先天的なろう者は日本手話が第一言語です。そして、日本手話は手以外にも表情なども使って情報伝達を行えるため、感情表現がより多彩にできます。先日行われた東京オリンピック・パラリンピックの閉会式では、ろう者による日本手話で手話通訳が行われていて、表情と表現が豊かな通訳が記憶に残っている人も多いと思います。

音声ガイド

映像の内容を音声で伝える方法です。テレビの地上波放送では「解説放送」という名前で提供されています。番組表に「解」というマークがついている番組では解説が提供されています。

ウェブアクセシビリティではWCAG(Web Contents Accessibility Guideline)2.0の「達成基準1.2.5 音声 (収録済み)」という達成基準が示されていますが、複数音声を切り替えて再生できるサービスやプレーヤーが少ないため、テキストで映像の内容を解説する方法で代替情報を提供している場合が多いです。

また、映画やDVD・Blu-rayには対応した作品に対して音声ガイドを提供する「UDCast」というアプリがあります。作品の冒頭で再生される特殊な音声をアプリが検知して、タイミングを合わせて解説を行う仕組みになっています。UDCastの動作確認ページがあるので、そちらから体験できます。

なお、アニメーションのDVDやBlu-rayディスクでは、音声ガイドはスタッフや声優の方々によるボーナストラックとして使われることが多いですが、映画「君の名は。」のディスクでは活弁士の方が解説を行う音声ガイドが入っていて、ディスクを再生すると冒頭で音声ガイドのアナウンスがテロップで表示されるという丁寧な作りになっています。

リアルタイムに代替情報を提供するには(ミーティング、イベント動画の情報保障)

以上、情報保障の方法をいくつか紹介しましたが、手話と要約筆記を除くといずれも完成された動画に対して編集時に追加する方法です。

それ以外のリアルタイムで情報保障する方法を紹介します。

リアルタイムに情報保障をする機能として、ウェブミーティングのツール・サービスの多くは音声をその場でテキストに起こす「キャプション」という機能を提供しています。

英語のみ対応している場合が多いですが、話の内容がその場でテキストに変換されるため、ミーティング中の発言内容の確認にも使えますし、後日議事録を作る場合の素材にしたり、キーワード検索でチャプター代わりに使うといった用途にも使えます。

ウェブミーティングでは、それぞれのサービスでキャプション機能を提供しています。(外部サイト)

- Zoomのライブ文字起こし

- Google Meetの字幕

- Cisco Webexのクローズドキャプション

- Slackのハドルミーティングのライブキャプション

- Microsoft Teamsのライブキャプション

SNSでもTwitterのSpacesはキャプション機能を提供しているため、文字で会話を見られます。

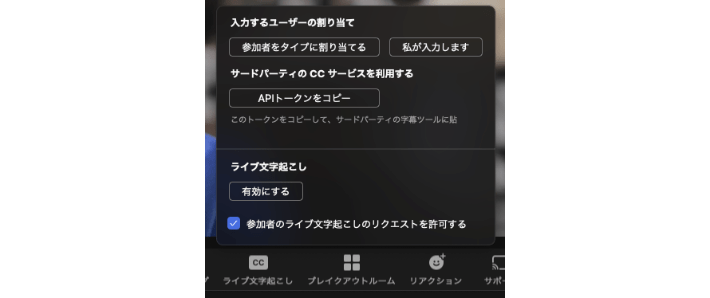

これはZoomのライブ文字起こし機能のスクリーンショットです。英語であれば「ライブ文字起こし」を有効にすると自動で文字起こしができるようになっていて、それに加えて手動入力と外部ツールからの入力にも対応しています。

また、ライブキャプションに特化した「UDトーク」「Group Transcribe」などのスマホアプリがあります。UDトークは日本語に対応していて、リアルタイム編集やZoom連携などの機能があったり、アプリ・ウェブ・プロジェクターモードなど表示方法があるため、アクセシビリティのイベントで使われることが多いです。私もよく使っています。

これはUDトークのスクリーンショットです。認識された音声にルビが振られて読みやすくなっています。

なお、これらのサービスは基本的にネットワーク経由でサーバーに音声を送って音声解析する場合が多いですが、スマホのGoogle Pixel6はAI処理に最適化されたチップを搭載することで、スマホ内部の処理で文字起こしができます。

動画プレーヤーのアクセシビリティ

以上、代替コンテンツの話をいくつかさせてもらいましたが、その代替コンテンツを含む動画プレーヤーやウェブミーティングに参加するためのアプリやウェブアプリのアクセシビリティも重要です。

動画プレーヤーは、現在はサービス各社がそれぞれ工夫を凝らしていますが、デバイス、利用方法それぞれで多様な使い方を想定したつくりになっているプレーヤーがある一方、キーボードだけではまったく操作できないプレーヤーもあったりするような状況です。

操作部分が多いためウェブアプリの中でも特に開発や実装のコストが高く、対応が難しい場合もあるかと思いますが、最低限再生と停止はできるようになるとよいですね…

一方、ウェブミーティングのツールは複数の国で展開している会社が開発している場合が多いため、スクリーンリーダーで全く使えないということはありません。しかし、ツール単体のアクセシビリティはよいのですが、アクセスするためのURLや会議室にアクセスするルールが複雑でアクセスしにくい場合があったりします。ここはブラウザーの中で完結するウェブページやウェブアプリと異なるツールなので、ミーティングに参加して終了するところまで考慮されているとなおよいですね。

まとめ

今回は、動画とライブ動画のアクセシビリティについて広くお伝えしました。

動画は静止画と比べて情報が多いため、代替情報もいくつかあります。それぞれ特徴があってメリットとデメリットがあるため、用途によって使い分けをすると効果的です。

ウェブサービスやデジタルデバイスの領域では、昨今動画と動画を用いたコミュニケーション(ウェブミーティング)の需要と利用が大幅に増えました。そこに追従するように音声解析とAIによる文字起こしの活用が急激に進むことで、徐々にアクセシビリティも改善されているように感じられます。今はまだ精度に課題がある場合もありますが、修正のほとんど不要な自動文字起こしができるような未来も遠くないと思います。

一方で、動画プレーヤーやウェブミーティングのUIなどで、動画にアクセスするためのアクセシビリティも考慮されていないと、代替情報があっても利用できない状態です。そこは動画単体ではなく、アクセス方法も含めたアクセシビリティの担保と向上が必要になります。機能と要素が多いので簡単ではありませんが、それができるようになると「多様なコンテンツを多様な利用方法で利用できる」状態になりますので、少しずつでも改善していきたいと思います。

こちらの記事のご感想を聞かせください。

- 学びがある

- わかりやすい

- 新しい視点

ご感想ありがとうございました