サイトオペレーション本部の藤見です。

物理サーバーの戦略、調達、運用を担当しています。

ヤフーはオンプレ環境で大量に物理サーバーを調達・運用しているCSP(*1)のひとつです。

オンプレ環境で物理サーバーの調達・運用はどのようなことをしているかを前回記事でご紹介しました。

今回はヤフーのサーバーインフラチームがどういった事を普段見ているか、という点をご紹介します。

目次

物理サーバー構成

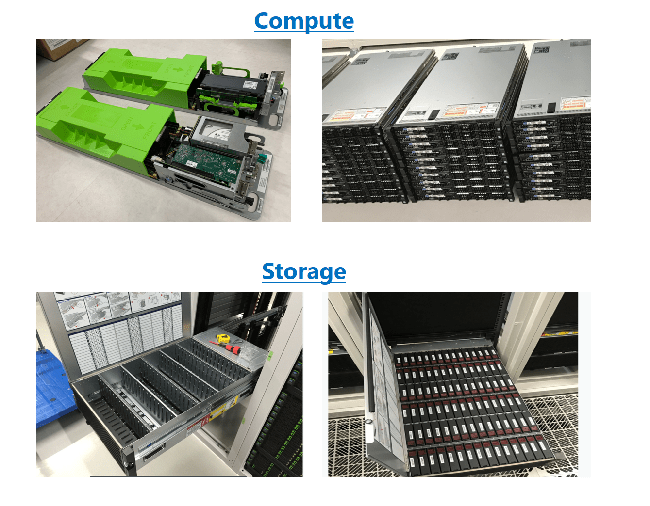

ヤフーでは調達、構成管理を効率化するためにサーバーの種別を大まかに下記の「3つ」に分類しています。

| 種別 | 構成の特徴 |

|---|---|

| Compute | ヤフーの大部分を占める サーバー、CPU、Memory、SSDにフォーカスした構成 |

| Storage | HDD大容量のサーバー、容量単価や集積度を重視した構成 |

| Other | ボリュームが少なかったり、ComputeやStorageに分類されない構成 |

下記図はComputeとStorageサーバーの一例です。

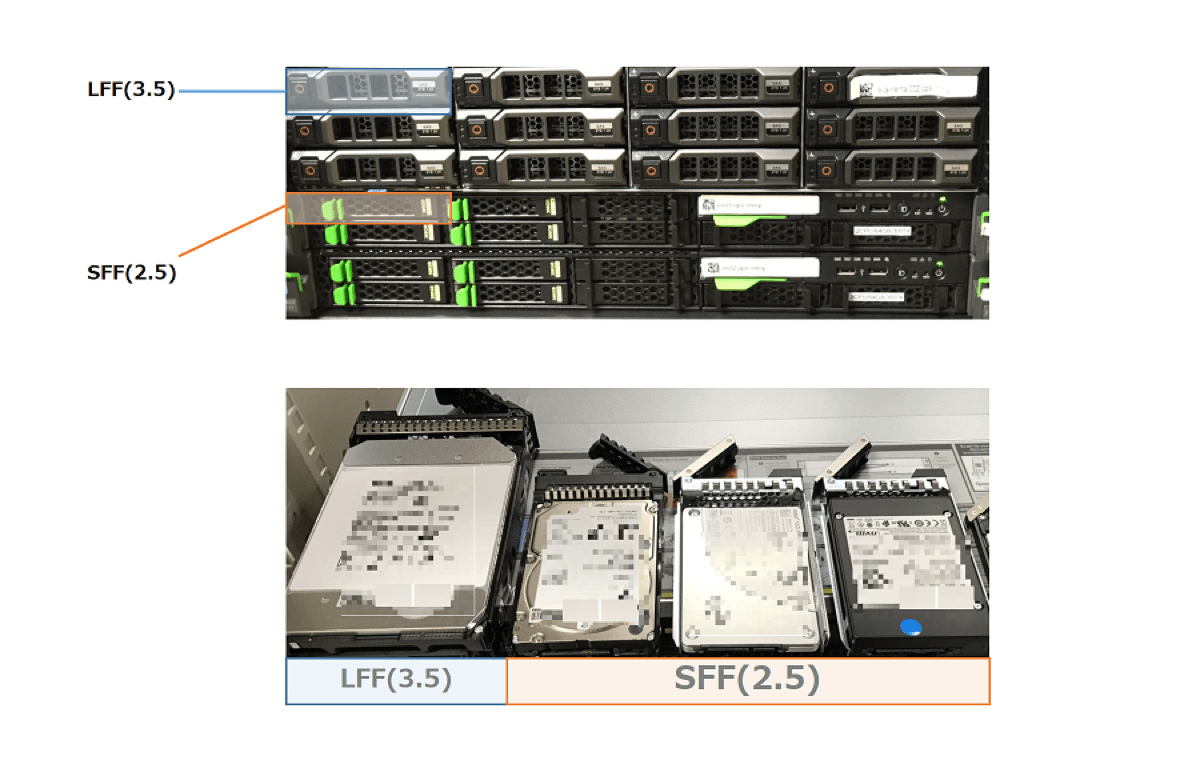

サーバー構成の特徴として、例えば下記のような構成ルールがあります。

- ComputeはSFF(2.5インチ)でディスクベイを統一

- StorageはLFF(3.5インチ)でディスクベイを統一

構成ルールを設定することで、調達時のボリューム創出や、運用時の手順統一、在庫の一元化をしています。

物理サーバーの管理

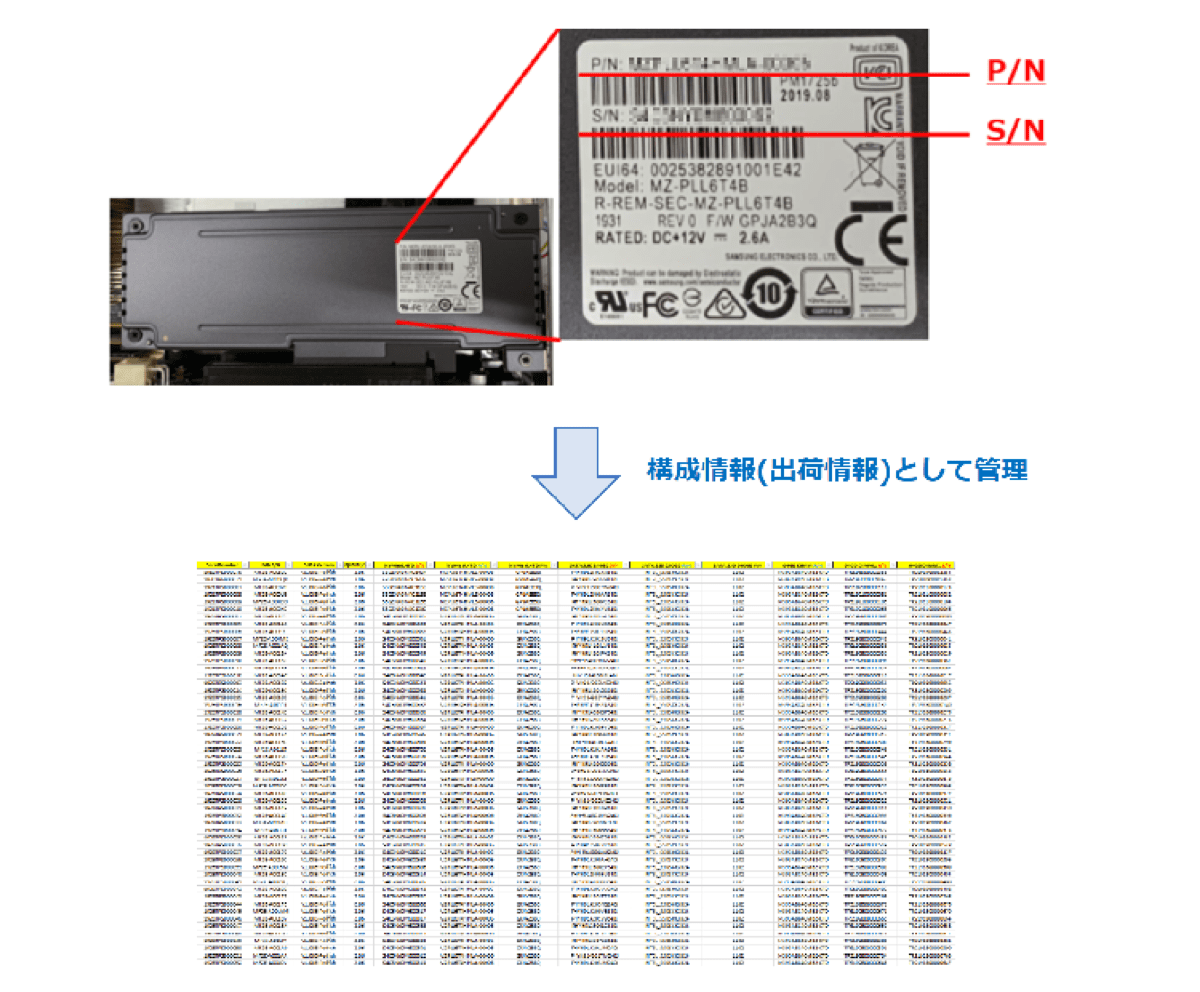

大規模なサーバーインフラ環境においては構成管理も重要な要素です。

ポイントとなる情報は主に下記です。

- サーバーベンダー

- 機種

- (サーバーの)SN(Serial Number)

- (サーバーの)PN(Part Number)

- BIOS/BMCのVersion

- 保守期間/保守条件

- 納品日

- サーバー構成

- パーツベンダー

- (パーツの)SN(Serial Number)

- (パーツの)PN(Part Number)

- (パーツの)Firmware Version

これらの情報はサーバーのH/Wインシデントが発生し、原因をトレースする際に起点となる情報のため、

管理し参照できるようにしています。

下記はパーツ(NVMe)のS/N, PNと管理情報の一例です。

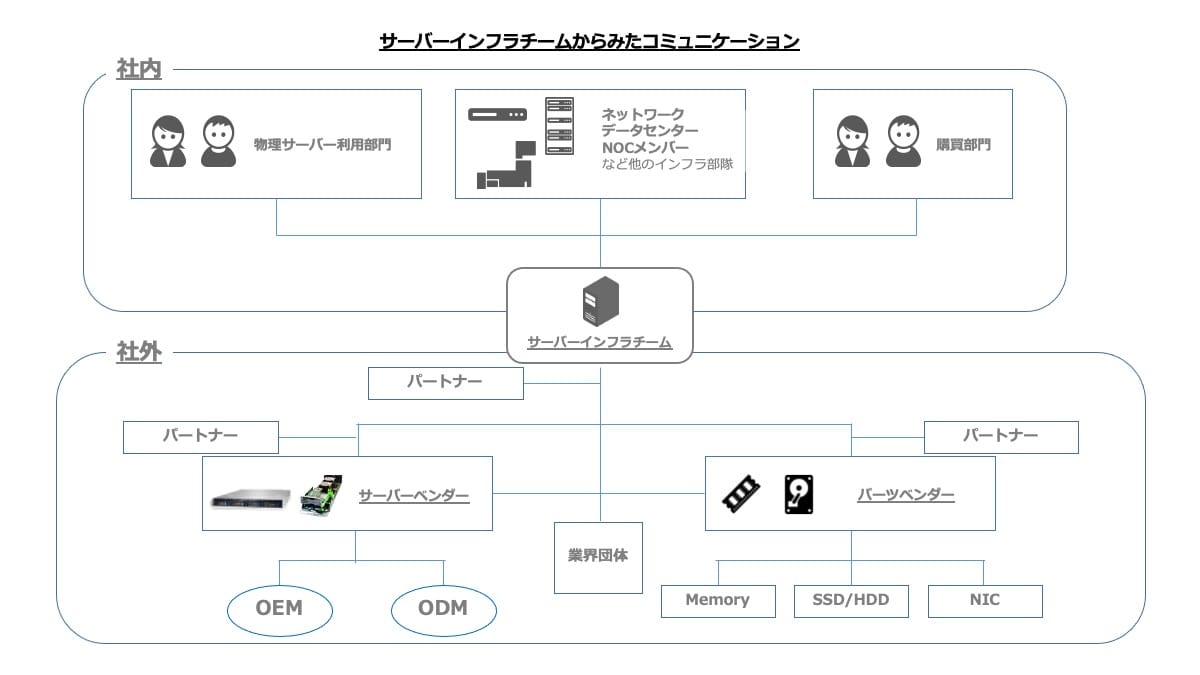

サーバーインフラチームのコミュニケーション

また、前述の構成情報(製造情報)の管理を含め、

サーバーインフラチームは社内/社外の各所とさまざまなコミュニケーションを取っています。

| コミュニケーション先 | 説明 |

|---|---|

| 物理サーバー利用部門 | 物理サーバーの構成検討、トラブルシュートなど | NW/DC/NOCなどのインフラ部隊 | 物理サーバーに構築に必要な情報の調整、確認、現地作業の連携など |

| 購買 | 物理サーバーの購買活動に関する対応など |

| パートナー | 販売代理店、保守代理店などのそれぞれの製品に特化したビジネスパートナー |

| サーバーベンダー | OEM/ODM系の国内外のサーバーベンダー |

| パーツベンダー | サーバーを構成する主要なコンポーネントのベンダー |

| 業界団体 | OCP CommunityやSNIAなどの団体(組織) |

物理サーバーの評価

物理サーバーを導入する前にヤフーでは、必ずサーバーの評価を実施します。

評価項目は大まかに分けると下記です。

- 物理運用性の評価

- パフォーマンスの評価

- 自社ツールの動作を評価

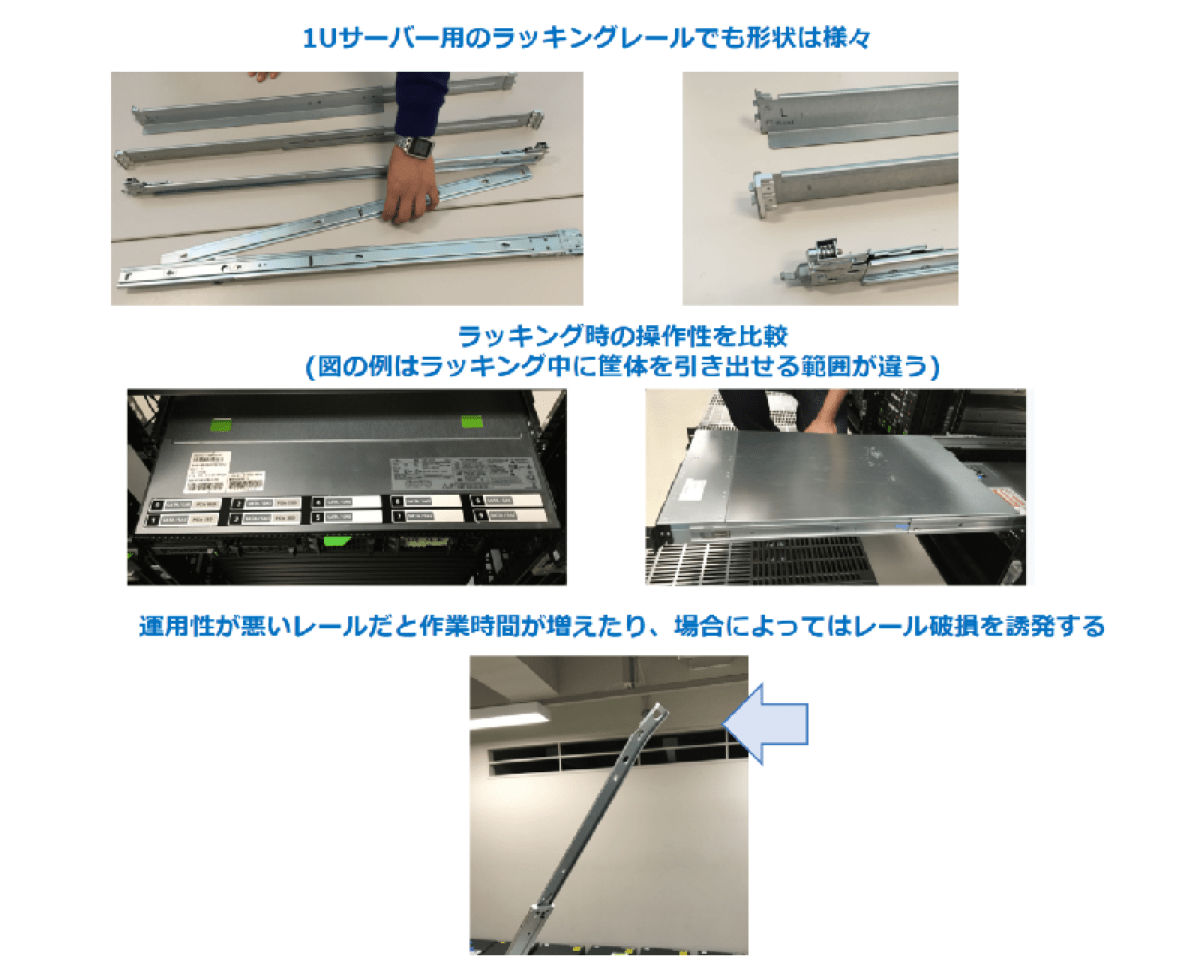

ヤフーの評価で特徴的なのは「物理運用性」の評価だと考えています。

オンプレミス環境で運用しており、物理作業の「簡単さ」「分かりやすさ」も全体の工数へ影響するため、注意している点です。

ラッキングレールの評価

ボタン、インジケーターの評価

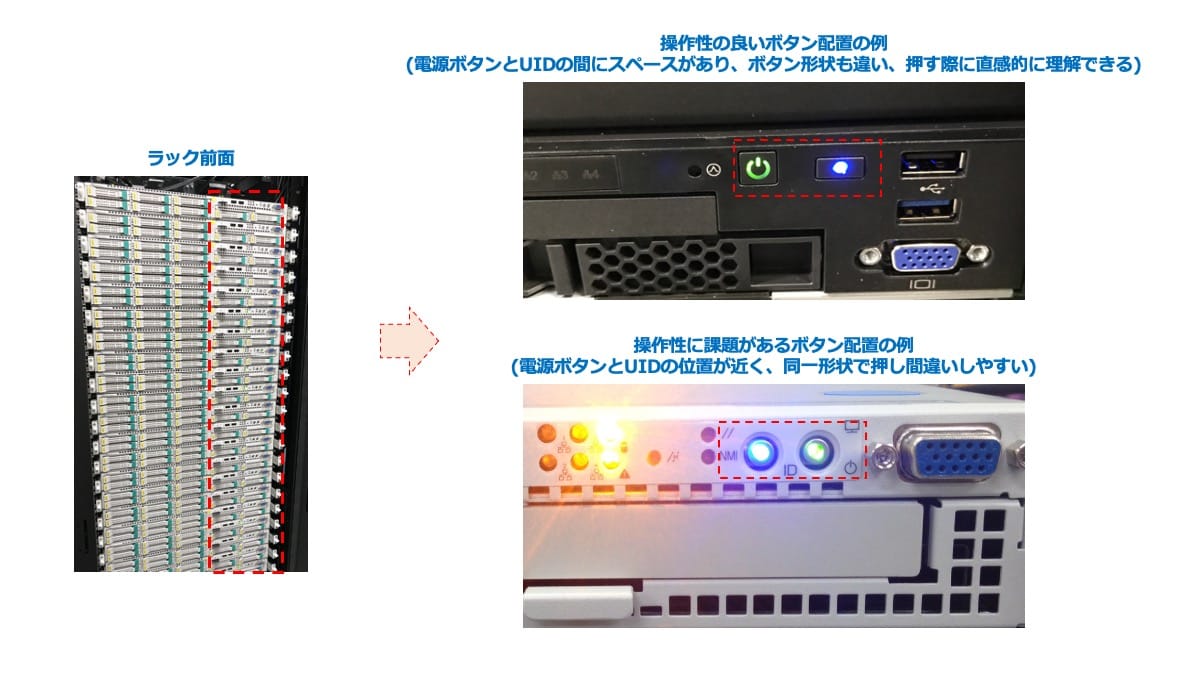

他の評価にボタン、インジケーターの評価があります。

データセンターの中で物理サーバーに対して物理的な作業する際には、

持ち込める物、参照できる情報が限定されています。

また、大量のサーバーがある中でピンポイントで作業する必要があるため、

現地作業者が目視で直感的に、かつリモートから作業指示者と認識を共有しやすいことが重要です。

下記はボタン評価の際に注意しているポイントです。

よくある作業として、電源ボタンを押す、UIDを押す(UIDを点灯させる)がありますが、

ボタン配置によってこの作業性は大きく変わります。

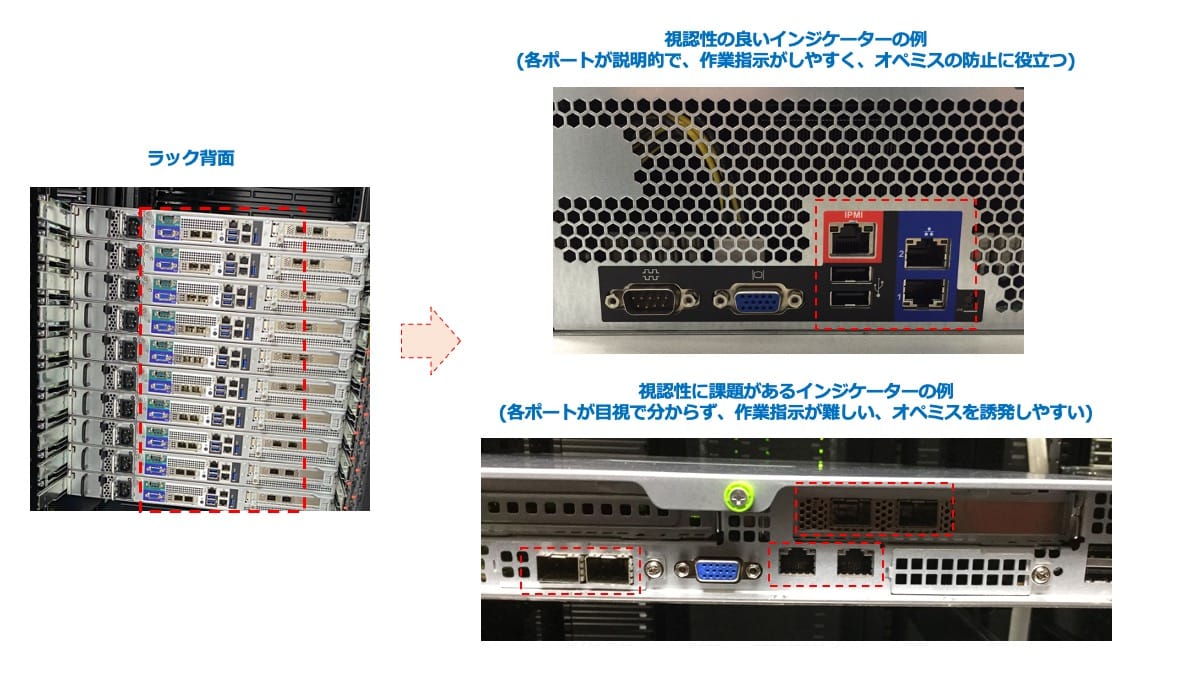

また背面のポート類の説明(インジケーター)もチェックしています。

「NIC1に配線したい」「NIC2だけ抜線したい」といった際に、

インジケーターが適切にある機種だとスムーズに作業ができます。

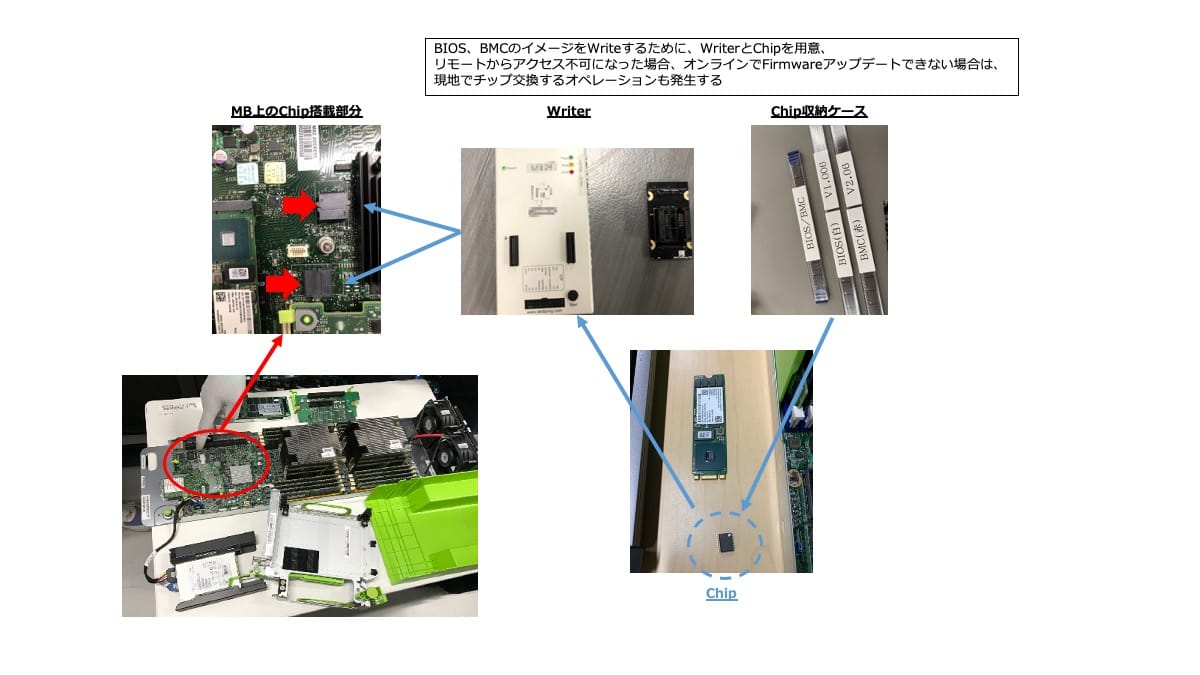

BIOS/BMCチップを焼いて交換、バージョンアップ

評価と関連した特徴的な作業を紹介します。

導入前に確認する項目にFirmwareのバージョンアップ手順確認というものがあります。

最近導入が増えているOCPサーバーではBIOS/BMCチップ単位でFirmware書き込みという作業を以下のように実施するケースもあります。

OCPサーバーとEIAサーバー

前章で物理的な運用性の評価を説明しましたが、

このようなベンダーごとの物理的な違いを減らして、統一を目指しているサーバーがOCPサーバーです。

前回記事でも少しOCPについては説明しましたが、

具体的な点についてご説明します。

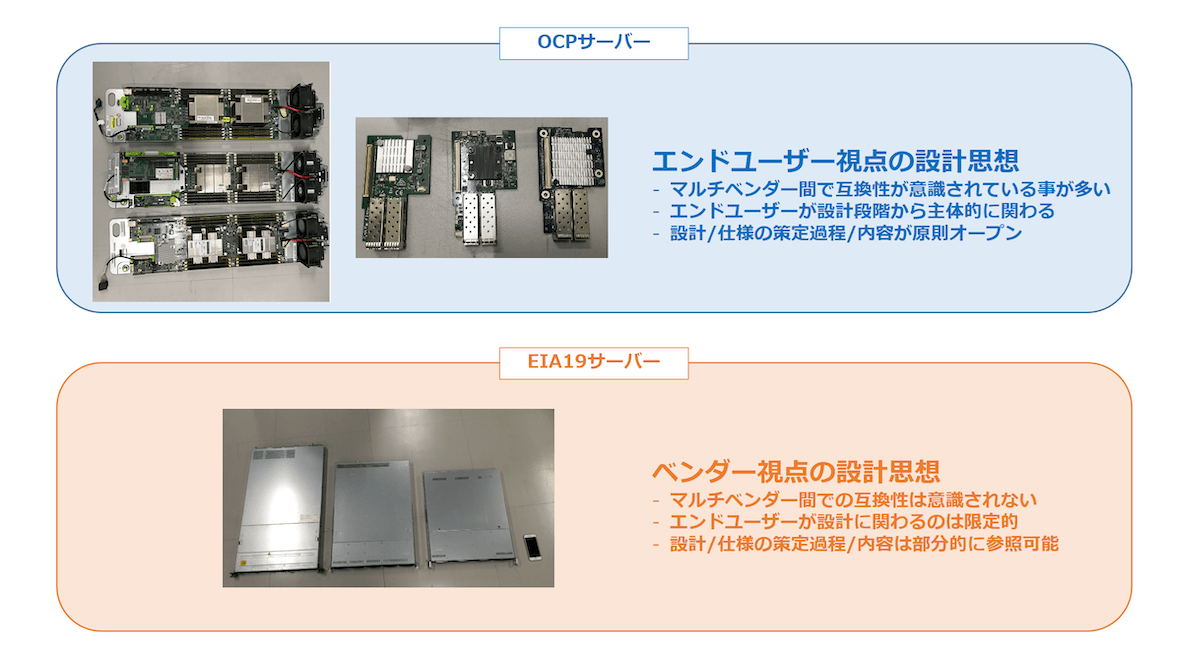

物理の設計思想の違い

まず大きい特徴として物理の設計思想が違います。

OCPはエンドユーザーが主体的に関わって設計されるのに対し、

従来のEIA19サーバーはベンダーが設計を主導しており、エンドユーザーが設計に関わる事はない(もしくは限定的)なのが一般的です。

現在議論中のOCPサーバーの情報はServer/Working - OpenComputeのページから見る事ができます。

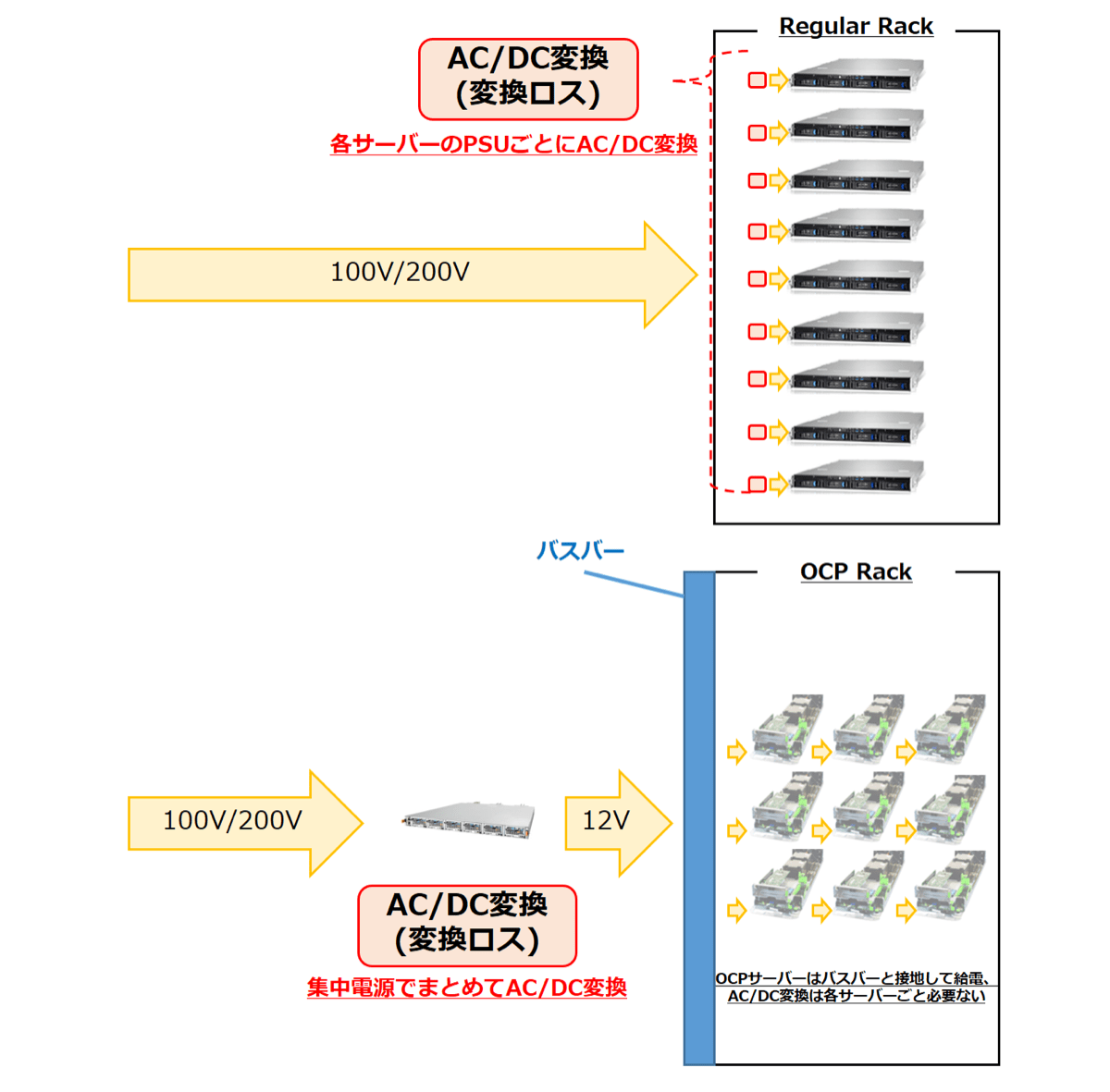

給電方式の違い

EIA19サーバーとOCPサーバーで給電方式にも違いがあります。

給電方式が下記のように異なります。

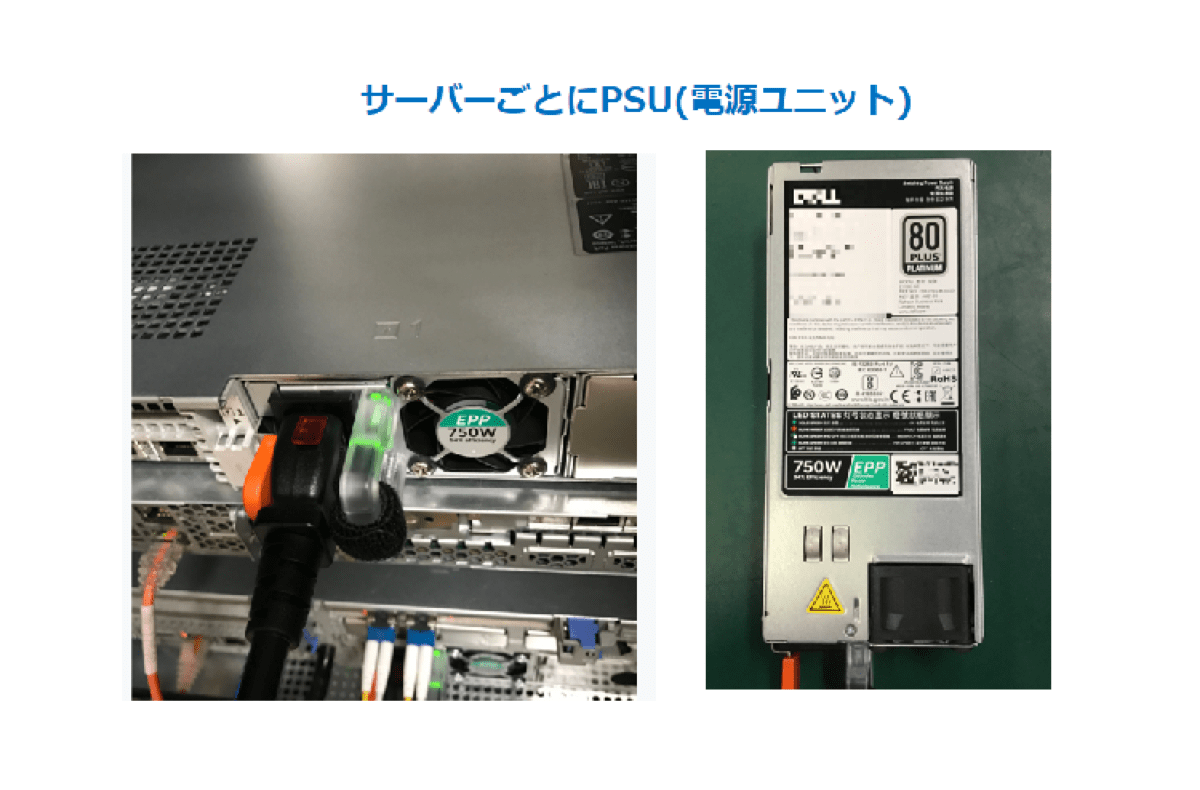

そのため、OCPサーバーにはEIA19サーバーにあったPSU(Power Supply Unit)はなく、

代わりにラック単位で(OCP用の)集中電源があります。

EIA19サーバー、一般的なPSUが各サーバーごとに付属しています。

OCPサーバー、こちらは各サーバーごとではなく、集中電源(OCP P/S)で一元的にAC/DC変換を行います。

集積度が高い

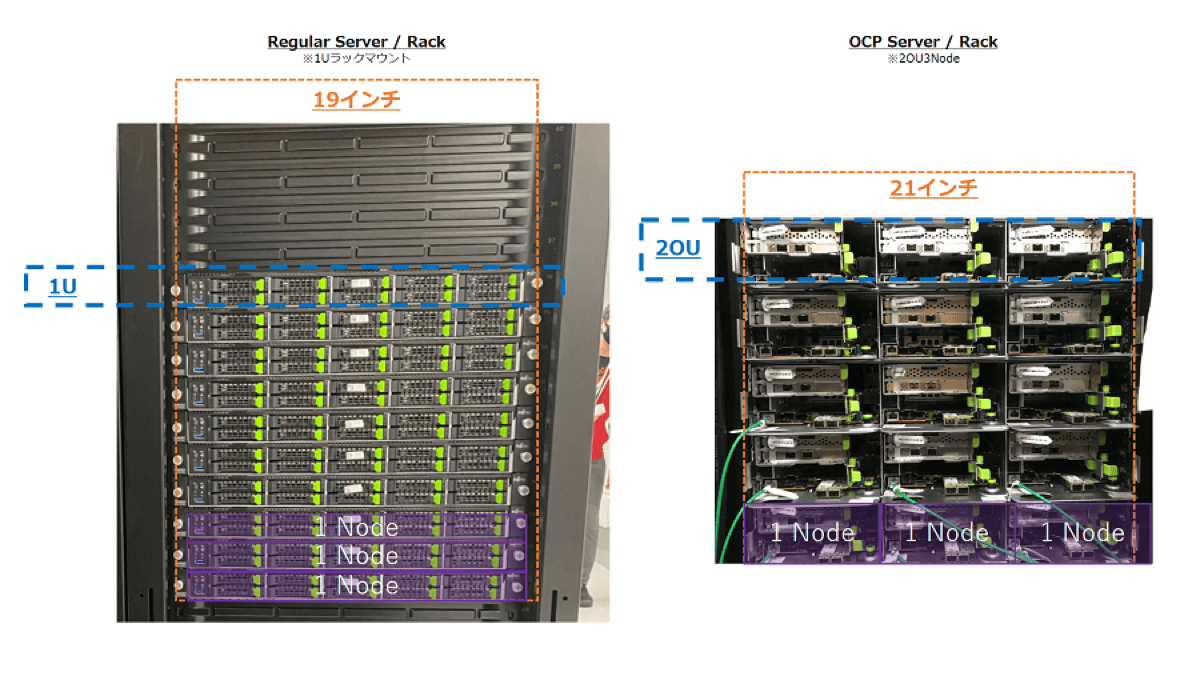

EIA19サーバーは高さが1U(44.45mm)幅が19インチ(482.6mm)と規定されており、

OCPサーバーは高さが1OU(48.00mm)幅が21インチ(533.4mm)となっています。

並べて図にしたものが下記です。

サーバー構成にもよりますが、OCPサーバーの方が、よりコンパクトな物理スペースで収納できることが多いため、

サーバーの集積度を高めることができると言われています。

最後に

ヤフーは大規模なオンプレ環境でサーバーを調達・運用しています。

サーバーの調達・運用は本記事、前回記事にてご説明した通り、

多種多様なタスクがあり、横にも縦にもスケールできる仕事だと思います。

今後もヤフーのサーバーインフラに興味を持っていただけたら幸いです。

(注釈)

CSP(*1) : Contents Service Provider

・文中のEIA19サーバー、Regular Serverは同じ1Uラックマウントサーバーを指します

・掲載写真は一例です

・掲載写真は全て許可が下りた場所で撮影したものです

こちらの記事のご感想を聞かせください。

- 学びがある

- わかりやすい

- 新しい視点

ご感想ありがとうございました

- 藤見 和英

- サーバーインフラエンジニア